El reciente auge y popularidad de ChatGPT y otras herramientas de Inteligencia Artificial (IA) en la educación como ClassPoint AI y muchas más han generado un importante debate entre los educadores. En la mayoría de los casos, el entusiasmo inicial de los educadores por estas revolucionarias herramientas de IA se ve inmediatamente contrarrestado por la preocupación por los riesgos y desafíos de su aplicación en la educación, desde las implicaciones éticas de la IA y el engaño hasta, en última instancia, la mayor preocupación de todas, la posible sustitución de los profesores humanos.

No es esto. Hay muchas verdades y riesgos oscuros sobre la IA que se ocultan de los debates públicos. Hoy nos centraremos en los inquietantes riesgos de la IA con episodios de la famosa serie de televisión Black Mirror. Antes sólo eran cuentos sobre los posibles escollos de la IA, pero ahora se están convirtiendo en realidad. Debatiremos si estos peligros de la IA en la educación deberían ser preocupaciones válidas de los educadores. Por supuesto, en el lado positivo, también exploraremos las oportunidades que los educadores pueden aprovechar de estas realidades aparentemente aterradoras, y prepararse mejor para un futuro mejor de la educación.

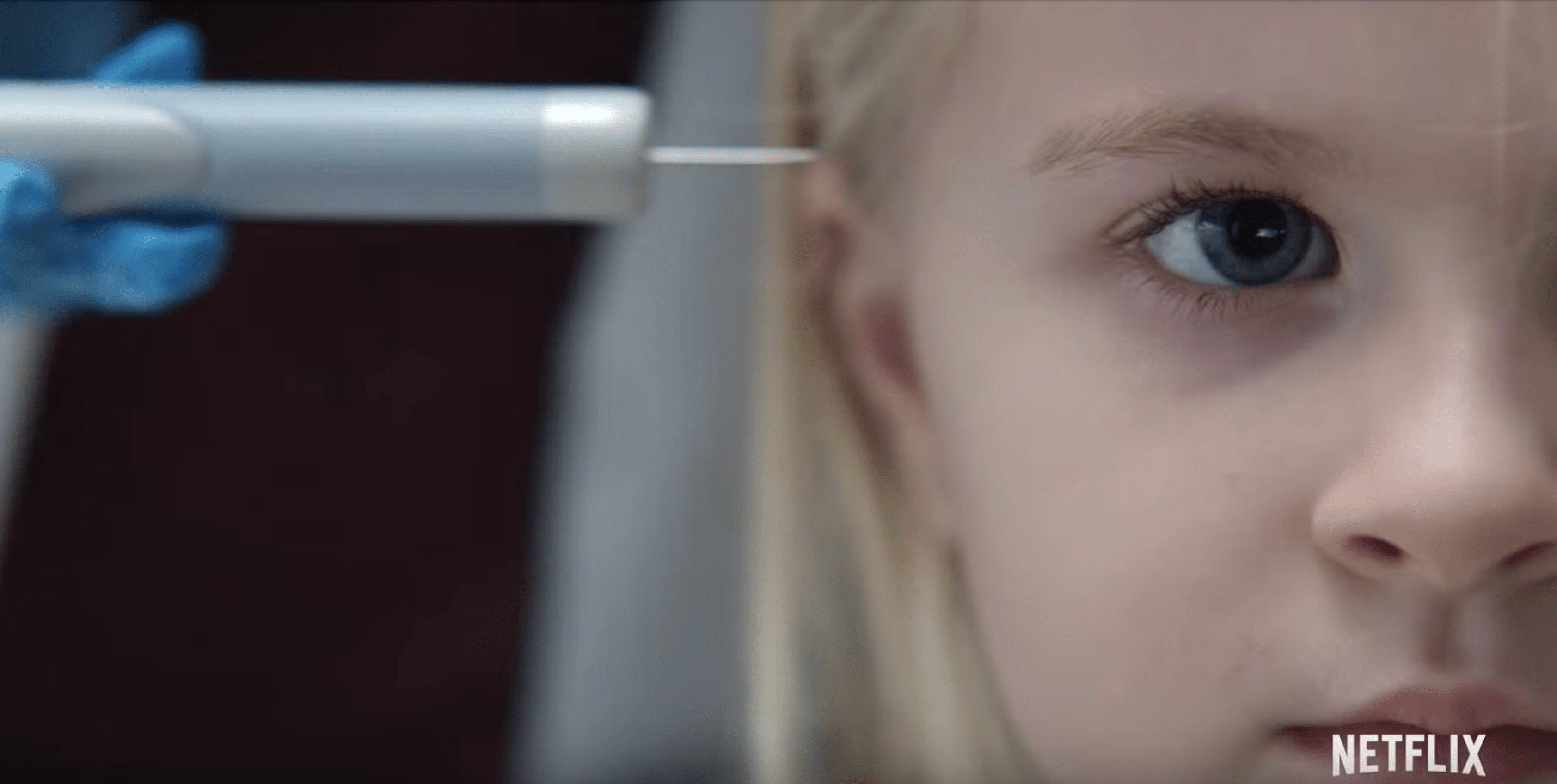

Black Mirror Temporada 4 Episodio 2 Arkangel Predicted Excessive AI Surveillance

Resumen: El episodio “Arkangel” de Black Mirror explora el tema de la vigilancia excesiva de la IA al describir un mundo en el que una madre llamada Marie tiene acceso a un sistema de vigilancia muy intrusivo en forma de chip implantado en el cerebro de su hija, Sara, que le permite controlar todos los detalles de su hija, incluida su ubicación, datos biológicos en tiempo real e incluso lo que ve. El dispositivo también permite a la madre censurar cualquier escena o visión brutal o negativa que pueda causarle angustia emocional, lo que se traduce en la pérdida de libertad y la asfixia del crecimiento y el desarrollo de Sara.

Vigilancia de la IA en la educación: Las herramientas de vigilancia de IA en la educación no son nuevas. Black Mirror Arkangel predijo acertadamente y se hizo eco de los temores reales de los educadores preocupados por las implicaciones de la tecnología de IA en la privacidad, la libertad intelectual y la independencia de los estudiantes. Por ejemplo, cada vez hay más aulas en China equipadas con cámaras de inteligencia artificial y rastreadores de ondas cerebrales, hasta bolígrafos inteligentes que rastrean a los alumnos y se aseguran de que realmente terminan sus deberes. Estos sistemas de vigilancia por IA corren el riesgo de crear en las aulas un ambiente de conformidad y control que socava el valor del aprendizaje autodirigido.

Oportunidades para los educadores: Cuando se utilizan adecuadamente con las directrices y barreras apropiadas, las herramientas de vigilancia de la IA pueden realmente proporcionar beneficios reales a los estudiantes. Por ejemplo, las herramientas de análisis del aprendizaje basadas en IA, como Brightspace Analytics y Carnegie Learning, pueden analizar los patrones de aprendizaje de los estudiantes, identificar las áreas en las que tienen dificultades y ofrecer recomendaciones personalizadas para mejorar. Las herramientas de intervención estudiantil, como Blackboard Predict, también pueden utilizarse para analizar los datos de los alumnos, como la asistencia y las calificaciones, para identificar a los estudiantes que pueden estar en riesgo de abandonar los estudios o que necesitan apoyo adicional, lo que permite a los educadores intervenir y proporcionar intervenciones específicas.

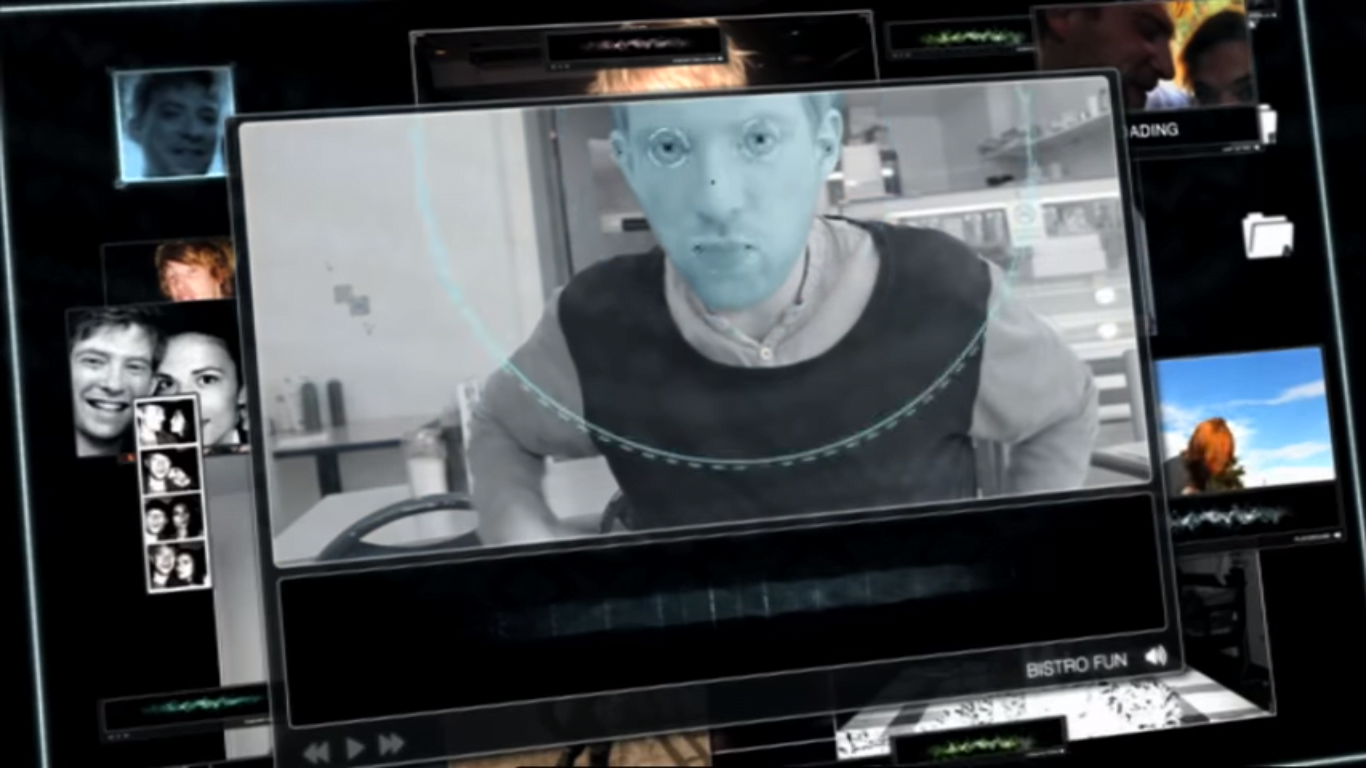

Black Mirror Temporada 4 Episodio 4 Hang the DJ predijo la excesiva dependencia de la IA en la toma de decisiones.

Resumen: El episodio “Hang the DJ” de Black Mirror presenta un avanzado sistema de emparejamiento llamado “Coach” que mide la compatibilidad amorosa de las personas y dicta la duración y el número de relaciones por las que pasa un individuo. Los dos protagonistas, profundamente enamorados, se rebelan contra el sistema que los separa continuamente y los empareja con otras parejas. Al final descubren que, en realidad, forman parte de una simulación diseñada para comprobar la compatibilidad de sus homólogos en la vida real, y sus actos de rebeldía al elegirse el uno al otro ponen de manifiesto su deseo de tener una agencia genuina y una conexión auténtica.

Educación para la toma de decisiones con IA: Actualmente no existe ningún sistema avanzado de IA de emparejamiento. Aunque existen herramientas de IA que ayudan a los educadores a tomar decisiones en su enseñanza, desde herramientas de IA en Orientación académica y profesional como Naviance y BridgeU y Admisiones universitarias como ZeeMee hasta Intervenciones estudiantiles como Starfish.

Oportunidades para los educadores: Black Mirror Hang the DJ sirve para recordar a todos los educadores que confiar ciegamente en la IA para la toma de decisiones es peligroso. Aunque es tentador y ahorra tiempo dejar que la IA tome todas las decisiones, confiar ciegamente en ella, especialmente en elecciones importantes como las oportunidades de educación de los estudiantes y las opciones profesionales, es una tontería.

Como educadores, también debemos valorar y evaluar continuamente la eficacia y el impacto de las herramientas de IA en el aula. Mediante una evaluación crítica de los sistemas de IA, los profesores pueden tomar decisiones mejores y más informadas sobre su uso e identificar las áreas en las que la intervención humana puede ser más apropiada.

No sólo los profesores, sino también los alumnos son susceptibles de dejar que la IA tome todas las decisiones en sus itinerarios de aprendizaje. Una gran preocupación de muchos educadores hoy en día es el aumento del plagio en los trabajos escolares con el uso de modelos lingüísticos de IA como ChatGPT. Sin embargo, en lugar de prohibir estas herramientas de IA en las escuelas, deberíamos enseñar a nuestros alumnos la capacidad de evaluar la eficacia de las herramientas de IA y los contenidos generados por IA para que sigan siendo responsables de sus propias decisiones de aprendizaje.

Black Mirror Temporada 2 Episodio 1 Be Right Back Predicted Communication With the Deceased

Resumen: Uno de los episodios mejor valorados de Black Mirror, Be Right Back explora la historia de una mujer llamada Martha que perdió trágicamente a su pareja en un accidente de coche, y finalmente buscó consuelo a través de una IA que imitaba completamente la personalidad, los recuerdos y los comportamientos de su pareja fallecida, Ash, primero a través de un chatbot de IA, y luego finalmente a través de un sustituto realista que fue diseñado para parecerse exactamente a Ash.

Chatbots de inteligencia artificial para comunicarse con los difuntos en la educación: Aunque no es tan realista como la tecnología de IA que vemos en Black Mirror, actualmente existen chatbots de IA como Sustitución que puede simular un interlocutor humano y, potencialmente, permitir a los usuarios simular una conversación con una persona fallecida.

Oportunidades para los educadores: Dejando a un lado las implicaciones éticas de replicar individuos, esta tecnología de IA podría ser útil para la simulación y para proporcionar una experiencia de aprendizaje más inmersiva y emocionante a nuestros estudiantes. Por ahora, los educadores también pueden hacer que los alumnos participen en la simulación de conversaciones con personajes históricos o pensadores influyentes a través de chatbots de IA como Hello History y ChatGPT, como se muestra aquí. Por supuesto, no se trata de auténticas conversaciones con los fallecidos, pero los estudiantes pueden beneficiarse de las perspectivas de los personajes históricos y utilizarlas para enriquecer sus argumentos y su aprendizaje.

Black Mirror Temporada 5 Episodio 3 Rachel, Jack y Ashley Predijeron la Pérdida de la Conexión Humana

Resumen: En el episodio de Black Mirror “Rachel, Jack y Ashley Too”, la historia gira en torno a Ashley Too, una muñeca asistente de inteligencia artificial creada basándose en la personalidad de Ashley O, una popular estrella del pop, y una chica llamada Rachel, propietaria de Ashley Too, que idolatra a Ashley O. Rachel recibe una muñeca Ashley Too como regalo de cumpleaños. Sin embargo, su afecto inicial por Ashley Too fue rápidamente sustituido por malestar cuando descubrió que Ashley O estaba en estado comatoso mientras su representante explotaba su conciencia para mantener su personaje público a través de Ashley Too.

La IA como apoyo a los estudiantes en la educación: Una de las mayores resistencias de los educadores hacia la IA tiene que ver con las limitaciones de esta para proporcionar experiencias de aprendizaje auténticamente emocionales y humanizadas. Existen chatbots de apoyo emocional como Woebot y Ellie que pueden ofrecer apoyo emocional y recursos de salud mental a los estudiantes ofreciéndoles un espacio sin prejuicios para que expresen sus pensamientos y emociones, así como sistemas de tutoría inteligente como KAI y Aprendizaje Carnegie que proporcionan instrucción y apoyo personalizados a los estudiantes mediante el análisis de los patrones individuales de aprendizaje y las áreas de debilidad para ofrecer retroalimentación y materiales de aprendizaje específicos.

Sin embargo, estas herramientas de IA carecen de emociones y empatía humana, lo que resulta esencial para comprender la complejidad de las emociones humanas y la conexión humana personal que necesitan los estudiantes para sentirse motivados, comprendidos y comprometidos. Estas limitaciones suponen un riesgo para el desarrollo de una generación de estudiantes emocionalmente distanciados y carentes de las habilidades necesarias para construir relaciones significativas.

Oportunidades para los educadores: Para prepararse para el futuro de la educación, los educadores tienen que dar prioridad a la conexión humana, la interacción social y el apoyo emocional dentro del aula para alimentar un sentido de conexión, empatía y comprensión entre los estudiantes cuando la IA no pueda hacerlo.

Black Mirror Temporada 3 Episodio 6 Hated in the Nation Predicted AI Bias and Discrimination

Resumen: El episodio “Hated in the Nation” de Black Mirror cuenta una historia en la que abejas robóticas con capacidades de IA, llamadas “ADIs” (Autonomous Drone Insects), son utilizadas para la polinización debido a la extinción de las abejas reales. Sin embargo, el sistema de IA fue pirateado, convirtiendo a los ADI en máquinas de matar. Al final, el sistema de IA mostró prejuicios y se centró en personas que habían sido objeto de campañas de odio en Internet.

Prejuicios y discriminación de la IA en la educación: El episodio Odio en la nación ilustra cómo los sistemas de IA pueden perpetuar los prejuicios y la discriminación hacia determinadas personas o grupos en función de los datos con los que se entrenan. Esto no es infrecuente en el mundo real. Por ejemplo, incluso el reciente viral ChatGPT ha sido declarado culpable en este aspecto. Los usuarios han denunciado casos en los que las modelos generaban contenidos sexistas, racistas u ofensivos por otros motivos.

En el ámbito de la educación, esto plantea la preocupación de cómo las herramientas de enseñanza de la IA pueden exacerbar las desigualdades y los prejuicios existentes en las aulas en ámbitos como la calificación, las recomendaciones, la orientación profesional o las admisiones. Por ejemplo, si los datos de entrenamiento utilizados para desarrollar estos sistemas de IA contienen sesgos, puede dar lugar a injusticias y discriminación en varios aspectos, desde la calificación injusta basada en factores no relacionados con su rendimiento real y la desigualdad de oportunidades para los grupos infrarrepresentados en la admisión a la universidad, hasta la orientación profesional basada en estereotipos de género y raza en la sociedad.

Oportunidades para los educadores: Como educadores, es importante darse cuenta de que el futuro de la educación impulsada por la IA no está únicamente en manos de las empresas y los responsables políticos. Desempeñamos un papel crucial en la configuración del futuro de la educación educándonos a nosotros mismos y a nuestros alumnos sobre los posibles sesgos y limitaciones de los sistemas de IA y fomentando las habilidades de pensamiento crítico, animando a los estudiantes a cuestionar y evaluar los resultados de las herramientas de IA en lugar de aceptarlos al pie de la letra. Podemos, y también debemos, tomar medidas proactivas para colaborar con los padres, los responsables políticos y los desarrolladores de IA para garantizar que las futuras tecnologías de IA en la educación se diseñen e implementen de forma responsable y en beneficio de nuestras futuras generaciones.

¿La sexta temporada de Black Mirror? Y cómo pueden prepararse los educadores para el futuro de la IA

¿Proporcionaría Black Mirror Temporada 6 una mejor predicción del futuro de la educación? Sólo nos queda esperar a ver cuándo se estrena la temporada.

Los episodios de Black Mirror hasta ahora han ilustrado que el futuro de la educación es una compleja interacción entre humanos y máquinas. La IA tiene el potencial de revolucionar la educación de una forma sin precedentes, pero depende de los educadores aprovechar sus ventajas sin perder de vista sus posibles inconvenientes.

Manteniéndose informados, críticos y adaptables, los educadores pueden ayudar a dar forma al futuro de la IA en la educación y garantizar que sirva a los mejores intereses de todos los estudiantes. Y lo que es más importante, los educadores deben utilizar la IA como herramienta de apoyo, no como sustituto de la enseñanza: la IA puede ayudar en tareas como el análisis de datos, la retroalimentación personalizada o la impartición de contenidos, pero no debe reemplazar la relación profesor-alumno.

En definitiva, los profesores deberían sentirse más entusiasmados que temerosos ante el futuro de la IA en la educación porque, aunque la IA es capaz de muchas cosas que hace décadas no eran posibles, los profesores son los verdaderos catalizadores de una futura generación civilizada, ética, crítica y humana a la que ninguna IA podría sustituir.

Para conocer los últimos consejos, tendencias y herramientas sobre la IA en la educación, lea nuestra guía de la A a la Z sobre la IA en la educación.