L’essor récent et la popularité de ChatGPT et d’autres outils d’intelligence artificielle (IA) dans l’éducation, tels que ClassPoint AI et bien d’autres, ont suscité un débat important parmi les éducateurs. Le plus souvent, l’enthousiasme initial des éducateurs à l’égard de ces outils d’IA révolutionnaires est immédiatement accueilli par des préoccupations concernant les risques et les défis liés à la mise en œuvre de l’IA dans l’éducation, qu’il s’agisse des implications éthiques de l’IA et de la tricherie ou, en fin de compte, de la plus grande préoccupation de toutes, le remplacement potentiel des enseignants humains.

Ce n’est pas le cas. L’IA comporte de nombreux risques et vérités plus sombres qui ne sont pas abordés dans les débats publics. Aujourd’hui, nous nous intéresserons aux risques inquiétants de l’IA avec des épisodes de la célèbre série télévisée Black Mirror. Alors qu’il ne s’agissait que d’histoires sur les pièges potentiels de l’IA, elles sont en train de devenir une réalité. Nous examinerons si ces dangers de l’IA dans l’éducation devraient être des préoccupations valables pour les éducateurs. Bien sûr, du côté positif, nous explorerons également les opportunités que les éducateurs peuvent tirer de ces réalités apparemment effrayantes, et mieux se préparer pour un meilleur avenir de l’éducation.

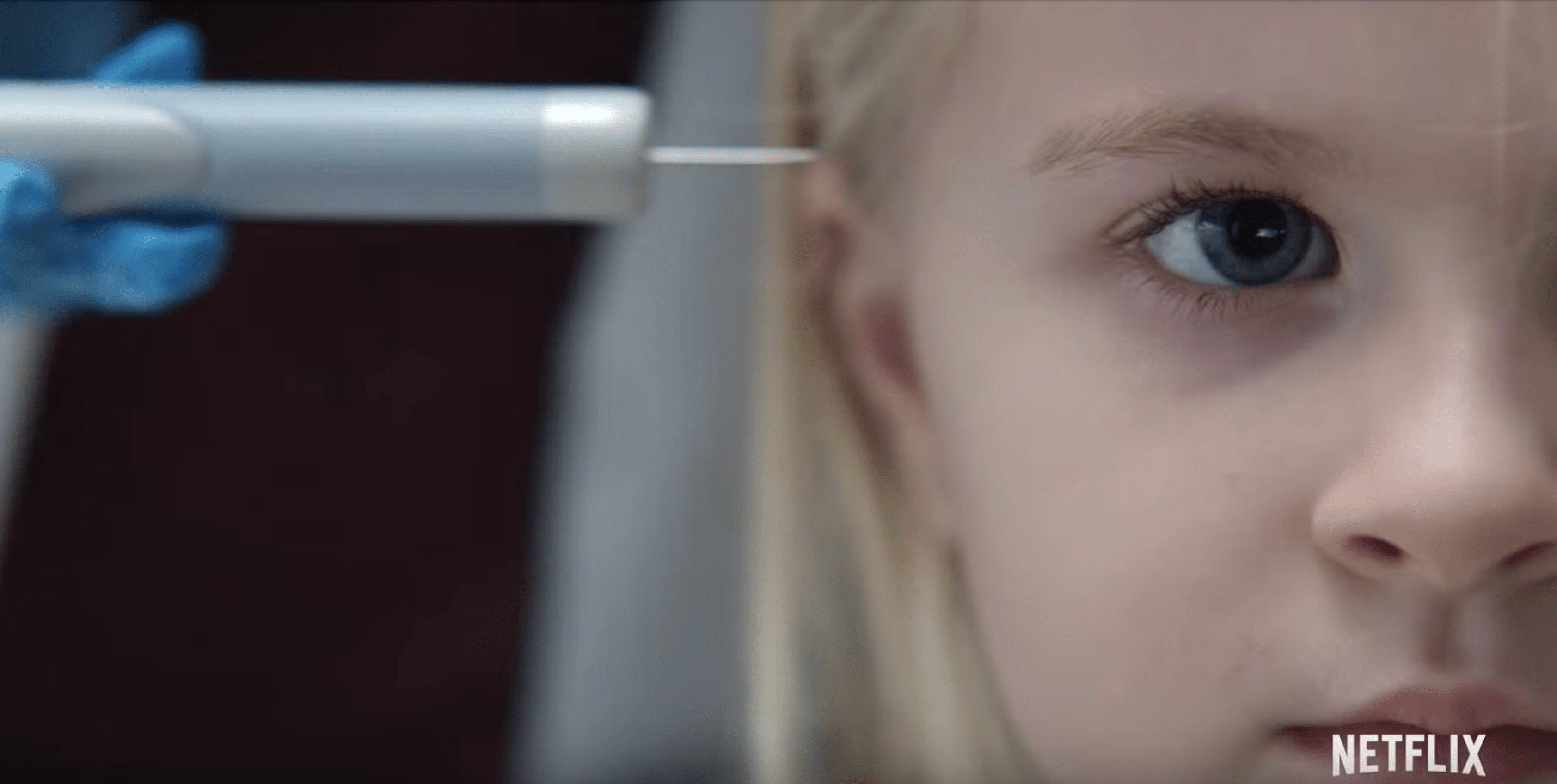

Black Mirror Saison 4 Épisode 2 Arkangel a prédit une surveillance excessive de l’IA

Résumé: L’épisode “Arkangel” de Black Mirror explore le thème de la surveillance excessive de l’IA en dépeignant un monde où une mère nommée Marie a accès à un système de surveillance très intrusif sous la forme d’une puce implantée dans le cerveau de sa fille, Sara, qui lui permet de surveiller les moindres détails de sa fille, y compris sa localisation, ses données biologiques en temps réel, et même ce qu’elle voit. Le dispositif permet également à la mère de censurer toutes les scènes ou images brutales ou négatives susceptibles de lui causer une détresse émotionnelle, ce qui a entraîné une perte de liberté et un étouffement de la croissance et du développement de Sara.

Surveillance de l’IA dans l’éducation: Les outils de surveillance de l’IA dans l’éducation ne sont pas nouveaux. Black Mirror Arkangel a prédit à juste titre et s’est fait l’écho des craintes réelles des éducateurs qui s’inquiètent des implications de la technologie de l’IA sur la vie privée, la liberté intellectuelle et l’indépendance des étudiants. En Chine, par exemple, un nombre croissant de salles de classe sont équipées de caméras d’intelligence artificielle et de détecteurs d’ondes cérébrales, ainsi que de stylos intelligents qui suivent les élèves et s’assurent qu’ils font bien leurs devoirs. Ces systèmes de surveillance par l’IA risquent de créer un environnement de conformité et de contrôle dans les salles de classe, ce qui compromet la valeur de l’apprentissage autodirigé.

Opportunités pour les éducateurs: Lorsqu’ils sont utilisés de manière appropriée, avec des directives et des barrières adéquates, les outils de surveillance de l’IA peuvent en fait apporter de réels avantages aux élèves. Par exemple, les outils d’analyse de l’apprentissage alimentés par l’IA, tels que Brightspace Analytics et Carnegie Learning, peuvent analyser les schémas d’apprentissage des élèves, identifier les domaines dans lesquels les élèves ont des difficultés et fournir des recommandations personnalisées en vue d’une amélioration. Outils d’intervention auprès des élèves Blackboard Predict peut également être utilisé pour analyser les données relatives aux élèves, telles que l’assiduité et les notes, afin d’identifier les élèves qui risquent de décrocher ou qui ont besoin d’un soutien supplémentaire, ce qui permet aux éducateurs d’intervenir et de proposer des interventions ciblées.

Black Mirror Saison 4 Épisode 4 Hang the DJ Predicted Over-reliance on AI on Decision Making

Résumé: L’épisode “Hang the DJ” de Black Mirror met en scène un système d’appariement avancé appelé “Coach” qui mesure la compatibilité amoureuse des individus et dicte la durée et le nombre de relations qu’ils vivent. Les deux protagonistes, profondément amoureux l’un de l’autre, se rebellent contre le système qui les sépare continuellement et les associe à d’autres partenaires. Ils finissent par découvrir qu’ils font en réalité partie d’une simulation conçue pour tester la compatibilité de leurs homologues dans la vie réelle et leurs actes de rébellion en se choisissant l’un l’autre signifient leur désir d’une véritable agence et d’une connexion authentique.

Formation à la prise de décision par l’IA: Il n’existe actuellement aucun système d’IA de matchmaking avancé. Bien qu’il existe des outils d’IA qui aident les éducateurs à prendre des décisions dans le cadre de leur enseignement, qu’il s’agisse d’outils d’IA pour l’orientation scolaire et professionnelle comme Naviance et BridgeU, d’outils d’admission à l’université comme ZeeMee ou d’outils d’intervention auprès des élèves comme Starfish.

Opportunités pour les éducateurs: Black Mirror Hang the DJ rappelle à tous les éducateurs qu’il est dangereux de se fier aveuglément à l’IA pour prendre des décisions. S’il est tentant de laisser l’IA prendre toutes les décisions et de gagner du temps, il est insensé de lui accorder une confiance aveugle, en particulier pour des choix importants tels que les possibilités d’éducation et les choix de carrière des étudiants.

En tant qu’éducateurs, nous devrions également évaluer en permanence l’efficacité et l’impact des outils d’IA dans la salle de classe. En évaluant de manière critique les systèmes d’IA, les enseignants peuvent prendre des décisions plus éclairées sur leur utilisation et identifier les domaines dans lesquels une intervention humaine serait plus appropriée.

Les enseignants, mais aussi les élèves, sont susceptibles de laisser l’IA prendre toutes les décisions dans leur parcours d’apprentissage. De nos jours, de nombreux éducateurs s’inquiètent de la recrudescence du plagiat dans les travaux scolaires grâce à l’utilisation de modèles linguistiques d’IA tels que ChatGPT. Cependant, au lieu d’interdire ces outils d’IA dans les écoles, nous devrions enseigner à nos élèves la capacité d’évaluer l’efficacité des outils d’IA et des contenus générés par l’IA afin qu’ils restent maîtres de leurs décisions d’apprentissage.

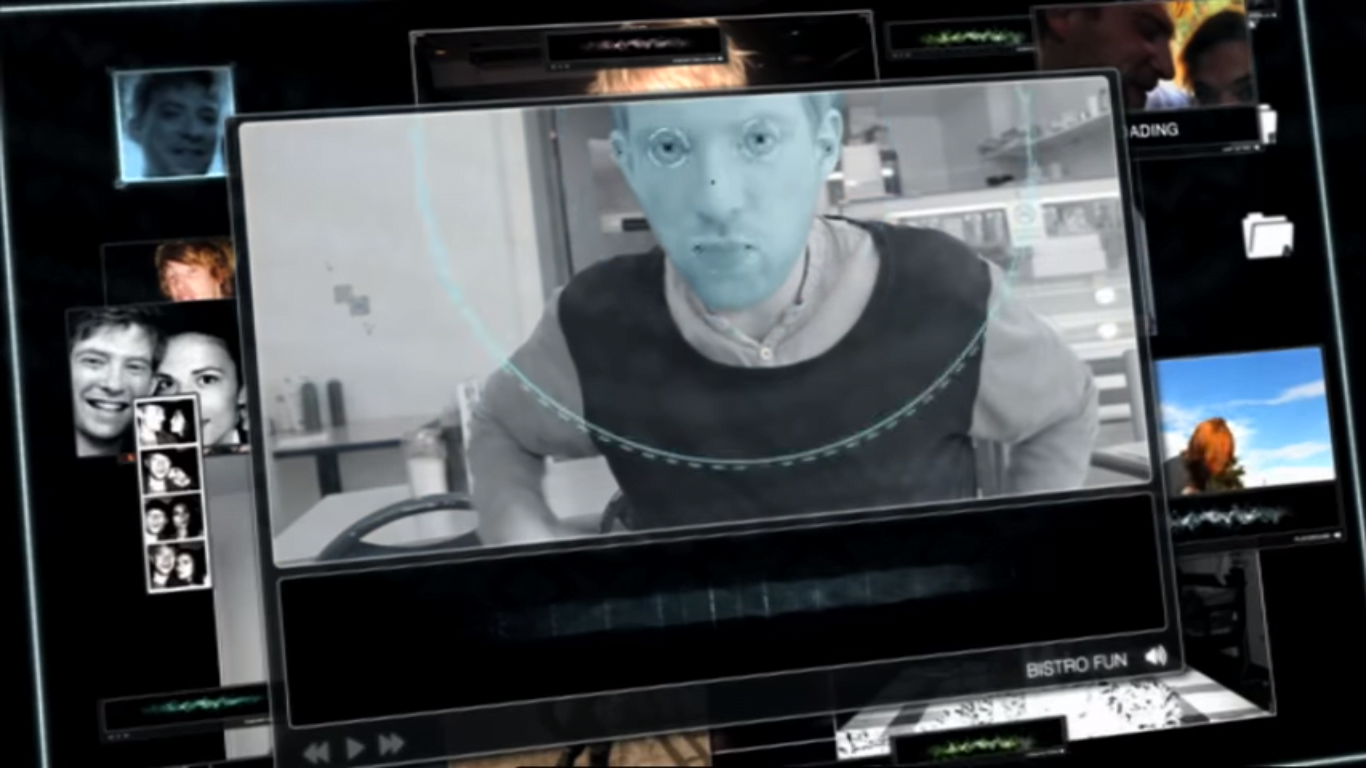

Black Mirror Saison 2 Épisode 1 Be Right Back Predicted Communication With the Deceased (Communication avec les personnes décédées)

Résumé: L’un des épisodes les plus populaires de Black Mirror, Be Right Back, explore l’histoire d’une femme nommée Martha qui a tragiquement perdu son partenaire dans un accident de voiture, et qui a finalement cherché du réconfort auprès d’une IA qui a complètement imité la personnalité, les souvenirs et les comportements de son partenaire décédé, Ash, d’abord par le biais d’un chatbot IA, puis finalement par le biais d’un substitut réaliste qui a été conçu pour ressembler exactement à Ash.

Des chatbots d’IA pour communiquer avec les défunts dans l’éducation: Bien qu’ils ne soient pas aussi réalistes que la technologie de l’IA que nous voyons dans Black Mirror, il existe actuellement des chatbots d’IA tels que Replika qui peut simuler un interlocuteur humain et peut potentiellement permettre aux utilisateurs de simuler une conversation avec une personne décédée.

Possibilités pour les éducateurs: Si l’on fait abstraction des implications éthiques de la reproduction d’individus, cette technologie d’IA pourrait être utile pour les simulations et pour offrir à nos étudiants une expérience d’apprentissage plus immersive et plus passionnante. Pour l’instant, les enseignants peuvent également faire participer les élèves à la simulation de conversations avec des personnages historiques ou des penseurs influents par l’intermédiaire de chatbots d’IA tels que Hello History et ChatGPT, comme illustré ici. Bien sûr, il ne s’agit pas de véritables conversations avec les défunts, mais les élèves peuvent certainement bénéficier des perspectives des personnages historiques et les utiliser pour enrichir leurs arguments et leur apprentissage.

Black Mirror Saison 5 Épisode 3 Rachel, Jack et Ashley ont prédit la perte des liens humains

Résumé: Dans l’épisode “Rachel, Jack and Ashley Too” de Black Mirror, l’histoire tourne autour d’Ashley Too, une poupée assistante créée à partir de la personnalité d’Ashley O, une pop star populaire, et d’une fille nommée Rachel, propriétaire d’Ashley Too, qui idolâtre Ashley O. Rachel reçoit une poupée Ashley Too comme cadeau d’anniversaire. Cependant, son affection initiale pour Ashley Too est rapidement remplacée par un malaise lorsqu’elle découvre qu’Ashley O est dans un état comateux tandis que son manager exploite sa conscience pour maintenir son personnage public par le biais d’Ashley Too.

L’IA pour le soutien aux élèves dans l’éducation: L’une des plus grandes résistances des éducateurs à l’égard de l’IA est liée aux limites de l’IA dans la fourniture d’expériences d’apprentissage authentiques, émotionnelles et humanisées. Il existe des chatbots de soutien émotionnel tels que Woebot et Ellie qui peuvent offrir un soutien émotionnel et des ressources en matière de santé mentale aux étudiants en leur offrant un espace sans jugement où ils peuvent exprimer leurs pensées et leurs émotions, ainsi que des systèmes de tutorat intelligents tels que le KAI et Carnegie Learning qui fournissent un enseignement et un soutien personnalisés aux étudiants en analysant les modèles d’apprentissage individuels et les domaines de faiblesse afin de fournir un retour d’information et des supports d’apprentissage ciblés.

Cependant, ces outils d’IA manquent d’émotions et d’empathie humaine, ce qui est essentiel pour comprendre la complexité des émotions humaines et le lien personnel dont les élèves ont besoin pour se sentir motivés, compris et engagés. Ces limites risquent d’entraîner la formation d’une génération d’étudiants détachés sur le plan émotionnel et dépourvus des compétences nécessaires pour nouer des relations fructueuses.

Opportunités pour les éducateurs: Pour préparer l’avenir de l’éducation, les éducateurs doivent donner la priorité à la connexion humaine, à l’interaction sociale et au soutien émotionnel au sein de la classe afin d’entretenir un sentiment de connexion, d’empathie et de compréhension chez les élèves lorsque l’IA ne peut pas le faire.

Black Mirror Saison 3 Épisode 6 Hated in the Nation Predicted AI Bias and Discrimination (en anglais seulement)

Résumé: L’épisode “Hated in the Nation” de Black Mirror raconte une histoire dans laquelle des abeilles robotisées dotées de capacités d’intelligence artificielle, appelées “ADI” (Autonomous Drone Insects), sont utilisées pour la pollinisation en raison de l’extinction des vraies abeilles. Cependant, le système d’IA a été piraté, transformant les ADI en machines à tuer. Le système d’IA a fini par faire preuve de partialité et a ciblé des personnes ayant fait l’objet de campagnes de haine en ligne.

Préjugés et discrimination dans l’éducation par l’IA: L’épisode “Hatred in the Nation” illustre la manière dont les systèmes d’IA peuvent perpétuer les préjugés et la discrimination à l’égard de certaines personnes ou de certains groupes sur la base des données sur lesquelles ils sont formés. Cette situation n’est pas rare dans le monde réel. Par exemple, même la récente campagne virale ChatGPT a été jugée coupable à cet égard. Des utilisateurs ont signalé des cas où les modèles ont généré du contenu sexiste, raciste ou autrement offensant.

Dans le domaine de l’éducation, cela soulève des inquiétudes quant à la manière dont les outils d’enseignement de l’IA peuvent exacerber les inégalités et les préjugés existants dans la salle de classe dans des domaines tels que la notation, les recommandations, l’orientation professionnelle ou les admissions. Par exemple, si les données d’apprentissage utilisées pour développer ces systèmes d’IA contiennent des biais, il peut en résulter des injustices et des discriminations à divers égards, qu’il s’agisse d’une notation injuste fondée sur des facteurs sans rapport avec les performances réelles, de l’inégalité des chances pour les groupes sous-représentés dans les admissions à l’université ou d’une orientation professionnelle fondée sur les stéréotypes de genre et de race en vigueur dans la société.

Opportunités pour les éducateurs: En tant qu’éducateurs, il est important de comprendre que l’avenir de l’éducation pilotée par l’IA n’est pas uniquement entre les mains des entreprises et des décideurs politiques. Nous jouons un rôle crucial dans l’élaboration de l’avenir de l’éducation en nous éduquant et en éduquant nos étudiants sur les biais potentiels et les limites des systèmes d’IA et en favorisant les compétences de pensée critique, en encourageant les étudiants à remettre en question et à évaluer les résultats des outils d’IA plutôt que de les accepter à leur valeur nominale. Nous pouvons et nous devons également prendre des mesures proactives pour collaborer avec les parents, les décideurs politiques et les développeurs d’IA afin de garantir que les futures technologies d’IA dans l’éducation soient conçues et mises en œuvre de manière responsable et dans l’intérêt de nos générations futures.

La saison 6 de Black Mirror ? Et comment les éducateurs peuvent se préparer à l’avenir de l’IA

La saison 6 de Black Mirror permettrait-elle de mieux prédire l’avenir de l’éducation ? Il ne nous reste plus qu’à attendre la sortie de la saison.

Les épisodes de Black Mirror ont jusqu’à présent montré que l’avenir de l’éducation est une interaction complexe entre les humains et les machines. L’IA a le potentiel de révolutionner l’éducation de manière inédite, mais il appartient aux éducateurs d’en exploiter les avantages tout en étant conscients de ses inconvénients potentiels.

En restant informés, critiques et adaptables, les éducateurs peuvent contribuer à façonner l’avenir de l’IA dans l’éducation et veiller à ce qu’elle serve au mieux les intérêts de tous les élèves. Plus important encore, les éducateurs doivent utiliser l’IA comme un outil de soutien et non comme un substitut à l’enseignement : l’IA peut contribuer à des tâches telles que l’analyse de données, le retour d’information personnalisé ou la fourniture de contenu, mais elle ne doit pas remplacer la relation entre l’enseignant et l’élève.

En effet, si l’IA est capable de réaliser de nombreuses choses qui n’étaient pas possibles il y a quelques décennies, les enseignants sont les véritables catalyseurs d’une future génération civilisée, éthique, critique et humaine, qu’aucune IA ne pourra remplacer.

Pour connaître les derniers conseils, tendances et outils sur l’IA dans l’éducation, lisez notre guide de A à Z sur l’IA dans l’éducation!